Imaginez un écosystème Web dans lequel non seulement les humains mais aussi les agents d’IA communiquent avec les sites Web, allant au-delà de la navigation traditionnelle. Contrairement aux expériences Web conventionnelles, dans lesquelles les internautes cliquent, font défiler et recherchent, les agents IA peuvent naviguer, interpréter et même effectuer des tâches de manière autonome sur votre site. Ce n'est pas un concept futuriste. Cela se déroule déjà. C’est l’émergence du web agent.

Points clés à retenir

- Le Web agentique permet aux agents IA de naviguer et d'interagir de manière autonome avec les sites Web, transférant ainsi les responsabilités des utilisateurs de la navigation manuelle à la prise de décision.

- Les protocoles sont cruciaux pour la communication entre les agents d’IA ; ils doivent s'appuyer sur des données structurées et lisibles par machine pour une coordination efficace

- Les professionnels du référencement doivent s'adapter au Web agent en optimisant les sites Web en tant que points de terminaison pour les requêtes d'IA, garantissant ainsi des données structurées et claires.

- NLWeb facilite l'interaction entre les agents et les sites Web en exposant des données structurées et en permettant des requêtes en langage naturel sans limitations d'interface traditionnelles.

- La collaboration de Yoast avec NLWeb aide les utilisateurs de WordPress à se préparer au Web agent en organisant le contenu et en facilitant l'intégration de données structurées.

Le grand changement : du Web pour les utilisateurs à un Web pour les utilisateurs et les agents

Pendant des années, le Web a suivi un modèle simple. Les humains ont recherché, cliqué, comparé et effectué des tâches manuellement. Même à mesure que les moteurs de recherche évoluaient, le modèle d’interaction est resté le même : rechercher et cliquer.

Ce modèle est en train de changer.

Le Web agent représente le passage d’un Web conçu uniquement pour les utilisateurs humains à un Web conçu à la fois pour les personnes et les assistants IA. Au lieu de rechercher manuellement des produits, de comparer des services, de remplir des formulaires et d'effectuer des transactions, les utilisateurs délégueront de plus en plus ces tâches à des assistants intelligents capables de rechercher, d'interpréter des informations et d'agir en leur nom. Le rôle de l'utilisateur passe de navigateur actif à décideur.

De la recherche à la délégation.

Il ne s’agit pas d’interfaces de chat plus intelligentes. Il s'agit d'agents autonomes capables d'interpréter l'intention de recherche, de comparer les options et d'exécuter des actions au nom des utilisateurs. Les sites Web ne sont plus simplement des pages à visiter. Ce sont des points de terminaison à interroger.

Pour que cela fonctionne à grande échelle, l’intelligence ne peut pas résider dans un seul assistant ou sur une plateforme fermée. Il faut le distribuer. Les systèmes doivent être capables de communiquer avec d’autres systèmes sans friction. Cela nécessite un Web lisible par machine, interopérable et conçu pour l’interaction d’agent à agent.

Le Web agent n’est pas une prédiction. C’est un changement architectural déjà en marche !

Pensée protocolaire et infrastructure de communication Web agentique

Si le Web agent concerne des systèmes intelligents interagissant avec des sites Web, alors la vraie question devient simple : comment ces systèmes se comprennent-ils ?

La réponse n’est pas la conception. C'est une infrastructure.

Le Web a toujours dépendu de règles de communication partagées. HTTP permet aux navigateurs de demander des pages. RSS distribue des mises à jour. Les données structurées aident les moteurs de recherche à interpréter le sens. Ce ne sont pas des fonctionnalités. Ce sont des protocoles. Ce sont des accords qui permettent une coordination à grande échelle.

Désormais, la même logique s’applique aux agents IA.

Dans le Web agent, les agents ne cliquent pas sur les boutons ni ne scannent visuellement les pages. Ils enverront des demandes, interpréteront des réponses structurées, compareront les options et effectueront des tâches. Pour que cela fonctionne sur des millions de sites Web, la communication ne s’improvise pas. Il doit être standardisé.

C’est là que la réflexion protocolaire devient essentielle.

La pensée protocolaire signifie concevoir des sites Web de manière à ce qu’ils soient prévisibles pour les machines. Au lieu de créer des intégrations personnalisées pour chaque assistant ou plateforme, les sites Web exposent une couche d'interaction cohérente. Les agents n'ont pas besoin d'apprendre toutes les interfaces. Ils s'appuient sur des règles partagées.

Comme l’ont souligné les discussions sur l’intelligence distribuée, l’objectif n’est pas de laisser un seul chatbot contrôler tout. Les renseignements doivent être distribués. Les systèmes ont besoin d'un moyen simplifié de communiquer sans avoir à comprendre les détails techniques de chaque outil auquel ils se connectent.

Cela ne fonctionne que lorsqu’il existe un terrain d’entente.

Concrètement, cela signifie :

- Les sites Web doivent exposer des données structurées et lisibles par machine

- Les agents doivent savoir ce qu'ils peuvent demander

- Les réponses doivent suivre des formats prévisibles

- La communication doit s'étendre au-delà d'une seule plateforme

Les protocoles créent ce langage partagé.

Qu’est-ce que cela signifie pour les professionnels du référencement ?

À mesure que le Web évolue pour prendre en charge les agents IA, les professionnels du référencement commencent à se poser une nouvelle question : comment rester visible lorsque les réponses sont générées au lieu d'être classées ?

Un exemple clair de cela est apparu lors de l'événement Ignite de Microsoft. Lors d'une séance de questions-réponses, un consultant a décrit un client qui vend des produits comme la mayonnaise et qui souhaitait que sa marque apparaisse lorsque quelqu'un interroge un assistant IA sur la mayonnaise. La question était simple, mais elle révélait quelque chose de plus profond. Si les systèmes d’IA génèrent des réponses au lieu de répertorier les résultats de recherche, à quoi ressemble l’optimisation ?

C’est là que le changement devient réel.

Le Web agent ne remplace pas le Web ouvert. Il ajoute une autre couche par-dessus. Les moteurs de recherche indexent toujours les pages. Les classements comptent toujours. Mais les systèmes intelligents peuvent désormais interroger directement les sites Web, comparer les informations entre les sources et générer des réponses synthétisées.

Pour les référenceurs, cela change le rôle du site Web.

Il ne suffit plus de penser en termes de pages à visiter. Les sites Web doivent être traités comme des points de terminaison à interroger.

Cela signifie que les données structurées, l’architecture d’informations propre et le contenu lisible par machine ne sont pas seulement des améliorations pour des résultats riches. Ils constituent la base qui permet aux systèmes d’IA d’interpréter et de sélectionner votre contenu en premier lieu.

Regardez l’événement complet ici !

Points clés à retenir pour les référenceurs

Le Web agent est une couche supplémentaire sur le Web ouvert, et ne le remplace pas. Pour rester visibles, les professionnels du référencement doivent s'assurer que leurs sites Web sont structurés, accessibles et prêts à être interrogés par des systèmes intelligents.

La visibilité dans cette nouvelle couche dépend de la clarté, de l'interopérabilité et de l'infrastructure.

A lire absolument : Pourquoi le fait d'avoir des informations sur plusieurs LLM est-il important pour la visibilité de la marque ?

Présentation de NLWeb

NLWeb a été introduit pour la première fois par Microsoft en mai 2025 en tant que projet ouvert conçu pour permettre aux sites Web d'offrir facilement des interfaces riches en langage naturel en utilisant leurs propres données et le modèle de leur choix. Plus tard, en novembre, lors du Microsoft Ignite, Microsoft a de nouveau présenté NLWeb aux côtés de sa première offre d'entreprise via Microsoft Foundry.

À la base, NLWeb vise à permettre à un site Web de fonctionner facilement comme une application d’IA. Au lieu de parcourir les pages manuellement, les utilisateurs et les agents peuvent interroger le contenu d'un site directement en utilisant le langage naturel.

Mais NLWeb est bien plus qu’une simple couche conversationnelle.

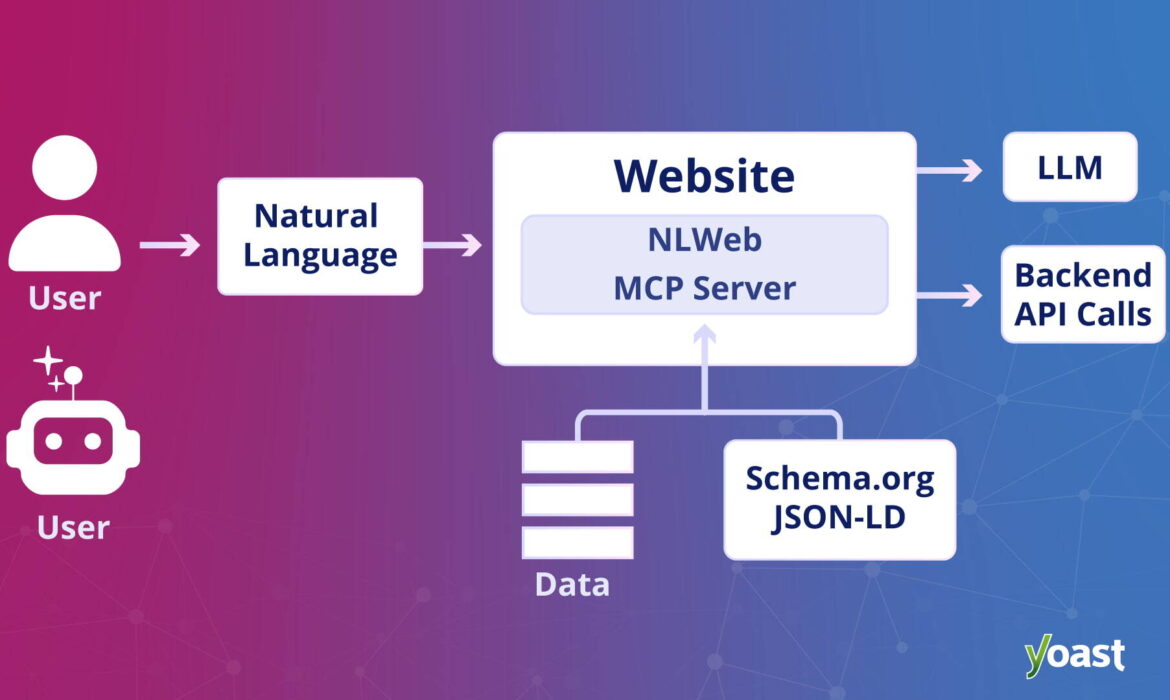

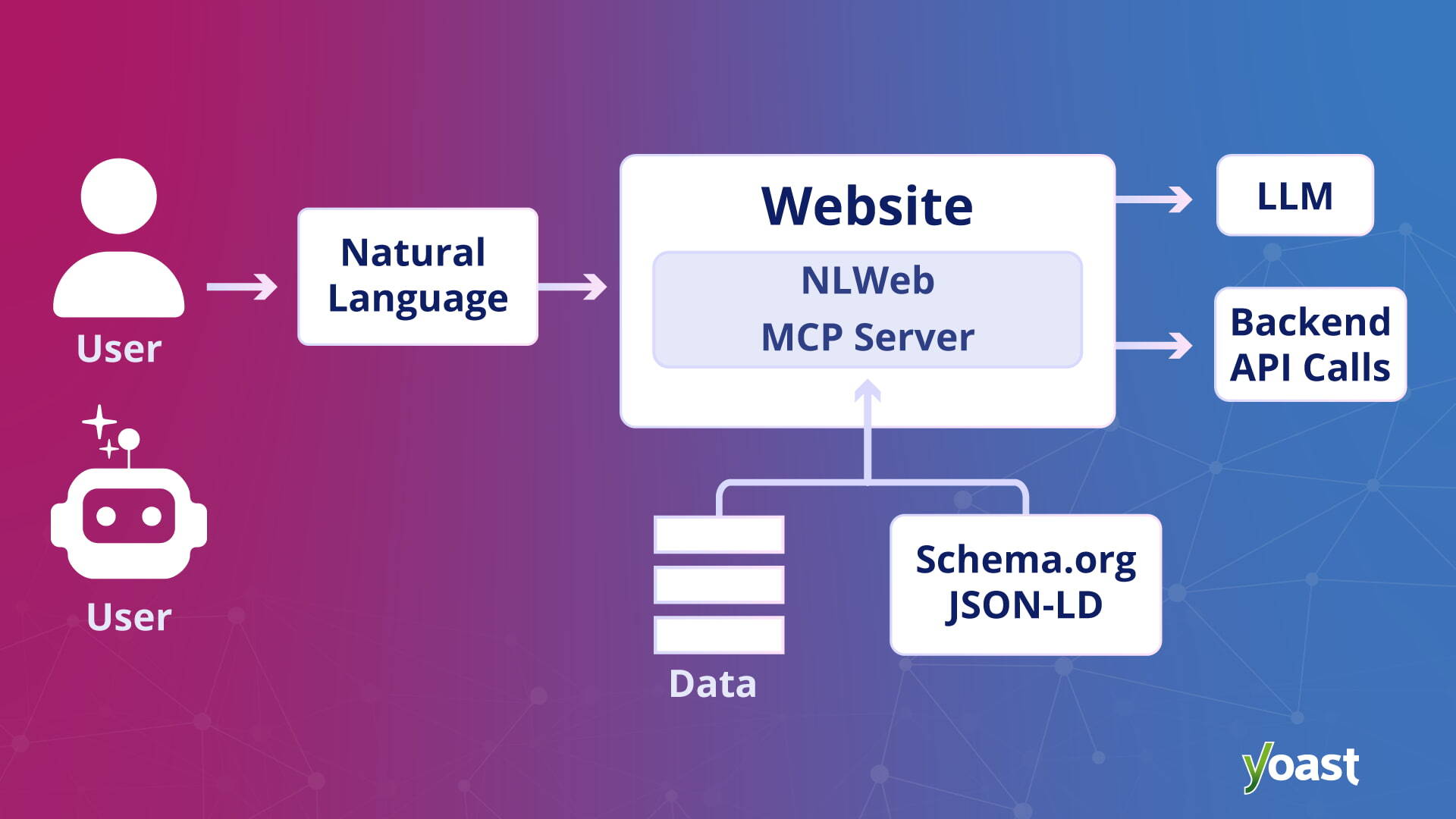

Chaque instance NLWeb est également un serveur Model Context Protocol, ou MCP. Cela signifie que lorsqu'un site Web active NLWeb, il devient intrinsèquement détectable et accessible aux agents opérant au sein de l'écosystème MCP. En termes simples, les agents n'ont pas besoin d'intégrations personnalisées pour chaque site. Si un site Web prend en charge NLWeb, les agents peuvent le reconnaître et interagir avec lui de manière standardisée.

NLWeb s'appuie sur des formats déjà utilisés par les sites Web, tels que Schema.org et RSS. Il combine ces données structurées avec de grands modèles de langage pour générer des réponses en langage naturel. Cela permet aux sites Web d’exposer leur contenu d’une manière que les humains et les agents d’IA peuvent comprendre.

Il est important de noter que NLWeb est indépendant de la technologie. Les propriétaires de sites peuvent choisir leur infrastructure, leurs modèles et leurs bases de données préférés. L’objectif est l’interopérabilité, et non le verrouillage d’une plateforme.

À bien des égards, NLWeb est en mesure de jouer un rôle dans le Web agent, similaire à ce que HTML a fait pour les premiers Web. Il fournit une couche de communication partagée qui permet aux agents d'interroger directement les sites Web, sans s'appuyer uniquement sur les interfaces d'exploration ou visuelles traditionnelles.

En quoi NLWeb est-il différent des citations LLM standard ?

Avec les citations LLM standard, le modèle génère d'abord une réponse, puis ajoute des sources. La réponse est encore probabiliste, ce qui peut introduire des inexactitudes ou des hallucinations.

NLWeb fonctionne différemment.

Il traite le modèle de langage comme une couche de récupération intelligente. Au lieu d'inventer des réponses, il extrait les objets vérifiés directement des données structurées du site Web et les présente en langage naturel.

Cette distinction est importante. Cela signifie que les réponses sont fondées dès le départ sur les propres données de l'éditeur, ce qui réduit le risque d'hallucination et donne aux propriétaires de sites un plus grand contrôle sur la manière dont leur contenu est représenté.

Ce que NLWeb signifie pour le Web agent

Le Web agent dépend de la capacité des systèmes à communiquer à grande échelle. Les agents ne peuvent pas interpréter manuellement chaque interface ou parcourir visuellement chaque page. Ils ont besoin d’un accès structuré et lisible par machine.

NLWeb aide à permettre cela.

Au lieu d'exiger des intégrations personnalisées pour chaque assistant ou plateforme, un site Web peut exposer un point de terminaison compatible NLWeb. Les agents doivent seulement savoir qu'un site prend en charge NLWeb. Le protocole gère la manière dont les demandes sont effectuées et la façon dont les réponses sont structurées.

Cela prend en charge un écosystème plus distribué. L’objectif n’est pas de laisser un chatbot tout contrôler. L’intelligence doit être distribuée sur le Web.

Les interfaces génératives ne remplacent pas le contenu. Ils dépendent d’un contenu bien structuré et accessible. Lorsqu’un système d’IA résume les résultats ou compare les options, il s’appuie toujours sur les informations fournies par les sites Web. NLWeb crée simplement un chemin plus clair pour cette interaction.

La collaboration de Yoast avec NLWeb et ce que cela signifie pour les utilisateurs de WordPress

Dans le cadre de l'annonce de NLWeb, Microsoft a présenté Yoast comme partenaire aidant à apporter des fonctionnalités de recherche agent à WordPress. Vous pouvez en savoir plus sur cette collaboration dans notre communiqué de presse officiel sur Yoast et l'intégration NLWeb de Microsoft.

Pour de nombreux propriétaires de sites WordPress, des concepts tels que l’infrastructure, les points de terminaison et les protocoles peuvent sembler abstraits. C’est exactement là que la préparation compte.

Bien que Yoast ne déploie pas automatiquement NLWeb pour les utilisateurs, la fonctionnalité d'agrégation de schémas dans Yoast SEO, Yoast SEO Premium, Yoast WooCommerce SEO et Yoast SEO AI+ organise et structure le contenu, ce qui facilite considérablement la création de NLWeb. Lorsque les propriétaires de sites activent la fonctionnalité Yoast appropriée, rien ne change visuellement sur le front-end. Ce qui change, c'est la structure sous-jacente.

En bref, nous cartographions et organisons les données structurées pour réduire l'effort technique requis pour créer NLWeb dessus. En d’autres termes, nous aidons les éditeurs à réaliser une grande partie du travail préparatoire.

Le Web agent ne consiste pas à suivre une tendance. Il s'agit de garantir que votre contenu reste détectable, compréhensible et utilisable dans un monde où les systèmes intelligents agissent de plus en plus au nom des utilisateurs.

Ahad Qureshi

Je suis diplômé en informatique et je suis tombé par hasard sur l'écriture et je suis resté parce que j'en suis tombé amoureux. Au cours des six dernières années, j'ai plongé dans le monde du référencement et du contenu technologique, transformant le jargon en histoires qui ont réellement du sens. Quand je n'écris pas, vous me trouverez probablement en train de soulever des poids pour équilibrer mon amour pour la nourriture (car oui, gym et biryani peuvent coexister) ou de retrouver des amis autour d'une bonne tasse de chai.